이 코드는 제가 학습하면서 참고했던 https://wikidocs.net/111472 예제 코드임을 밝힙니다.

오타가 났다! SGD인데! 참고로 Stochastic Gradient Descent: 배치가 1인 경사 하강법(확률적 경사하강법)이라는 뜻인데, 배치는 지금 알아둘 필요는 없고 나중에 딥러닝 챕터에서 자세히 소개할 것이다.

참고로 위 코드를 실행하면?

위와 같은 결과가 나온다! 보다시피 epoch(에포크라고 하는데 이것도 딥러닝 챕터에서 배치와 같이 설명할 예정이다) 횟수가 많아질수록 cost의 값이 점차 0에 가까워짐을 확인할 수 있다! 이 말인 즉슨, 경사하강법을 통해 0에 가까운 손실을 최소화하는 최적의 값으로 올바르게 찾아가고 있다는 것이다.

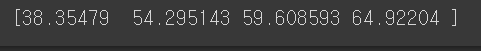

그럼, 위에서 임의로 설정한 x_test값을 가설함수에 넣어 예측값을 출력해보면?

위와 같은 결과가 나왔다!

'인공지능(ML) > 딥러닝' 카테고리의 다른 글

| 로지스틱 회귀 (0) | 2023.09.16 |

|---|---|

| 코드 실습: 선형 회귀(케라스) (0) | 2023.09.16 |

| 최적화 알고리즘: 경사하강법 (0) | 2023.09.16 |

| 비용함수를 쓰는 이유 (0) | 2023.09.16 |

| 목적함수, 비용함수 그리고 손실함수 (0) | 2023.09.16 |